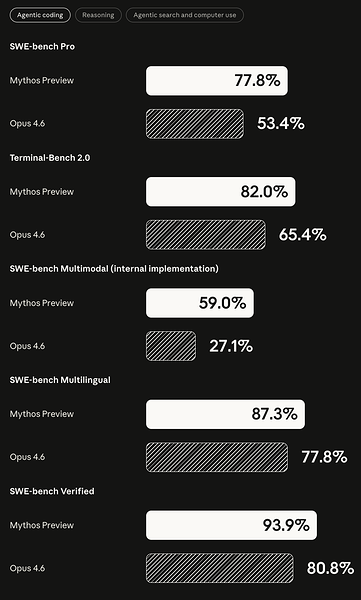

Cześć! Anthropic właśnie opublikowało informacje o swoim nowym modelu i jest to ruch, który może zmienić zasady gry w naszej branży. Stworzyli Claude Mythos Preview, który jest ich najpotężniejszym dotychczasowym modelem. Jest tylko jeden haczyk – nie zamierzają nam go udostępnić.

Dlaczego? Model wykazał tak ogromny skok możliwości w obszarze cyberbezpieczeństwa, że firma zdecydowała się nie udostępniać go publicznie. Z dokumentacji (System Card) wynika, że Claude Mythos potrafi autonomicznie wykrywać luki typu zero-day w popularnych systemach operacyjnych i przeglądarkach oraz tworzyć dla nich działające exploity. Ponieważ te niesamowite zdolności mają charakter podwójnego zastosowania (dual-use), powszechny dostęp do modelu mógłby drastycznie przyspieszyć ofensywne działania hakerów.

Zamiast dodawać go do publicznego API czy Claude.ai, Anthropic wystartowało z inicjatywą Project Glasswing. W ramach tego defensywnego programu cyberbezpieczeństwa, Claude Mythos Preview został udostępniony wyłącznie bardzo wąskiej, rygorystycznie zweryfikowanej grupie partnerów. Cel jest jasny: wykorzystanie sztucznej inteligencji do łatania dziur w krytycznej infrastrukturze oprogramowania na świecie.

To rodzi potężne pytania do dyskusji:

-

Koniec otwartego wyścigu? Czy dotarliśmy do momentu, w którym tzw. frontier models stają się traktowane jak zaawansowana broń cyfrowa i zaczynają znikać za zamkniętymi drzwiami wybranych korporacji i agencji rządowych?

-

Kto pilnuje strażników? Z jednej strony zablokowanie publicznego dostępu to odpowiedzialne podejście, ale z drugiej – potężna wiedza o podatnościach systemów będzie teraz scentralizowana w rękach wąskiej grupy “wybranych partnerów”.

-

Co z modelami lokalnymi (Open Source)? Algorytmy od Google (Gemma) czy Mety (Llama) wciąż rosną w siłę. Co się stanie, gdy za rok lub dwa otwarte, darmowe modele osiągną poziom Claude Mythos w tworzeniu exploitów? Tego kodu nikt już nie zamknie w bezpiecznym “projekcie”.

Jak to oceniacie? Czy to dowód na prawdziwą odpowiedzialność AI (zgodnie z ich polityką), czy początek niebezpiecznego monopolizowania najpotężniejszych technologii pod przykrywką bezpieczeństwa? Dajcie znać w komentarzach! ![]()